NVIDIA集成AI超算中心經(jīng)驗(yàn),,打造AI就緒型數(shù)據(jù)中心

文|智東西

傳統(tǒng)數(shù)據(jù)中心向人工智能(AI)轉(zhuǎn)型已是大勢(shì)所趨。

一方面,,從智能客服,、智能安防、智能風(fēng)控,、智能運(yùn)維到智能質(zhì)檢,,愈加豐富的智能化應(yīng)用致使存儲(chǔ)需求呈現(xiàn)指數(shù)級(jí)增長,并對(duì)數(shù)據(jù)中心的算力提出新的挑戰(zhàn),。

另一方面,,AI 正打破傳統(tǒng)數(shù)據(jù)中心的管理和運(yùn)營模式,,完成更為精準(zhǔn)的系統(tǒng)調(diào)優(yōu),、故障預(yù)判等任務(wù),替代更多人力,,減少能耗和資源浪費(fèi),,更大程度釋放生產(chǎn)力。

作為 AI 時(shí)代的基礎(chǔ)設(shè)施,,AI 硬件正成為越來越多數(shù)據(jù)中心擴(kuò)容建設(shè)的關(guān)鍵所在,。尤其是能源、銀行、保險(xiǎn),、制造,、電信、醫(yī)療等重度存儲(chǔ)用戶,,急需加速 AI 的基礎(chǔ)架構(gòu)方案,。

當(dāng)超強(qiáng)計(jì)算力成為數(shù)據(jù)中心的剛需,NVIDIA GPU 憑借強(qiáng)大的并行計(jì)算和浮點(diǎn)能力突破了深度學(xué)習(xí)的算力瓶頸,,成為 AI 硬件的首選,。

然而,對(duì)于許多傳統(tǒng)數(shù)據(jù)中心而言,,部署包含 AI 硬件的基礎(chǔ)設(shè)施,,需要耗費(fèi)許多時(shí)間與人力。

對(duì)此,,NVIDIA 基于 GPU 軟硬件生態(tài)系統(tǒng),,提供了一站式交付節(jié)點(diǎn)解決方案 DGX POD。

這一方案可以大大節(jié)省構(gòu)建基礎(chǔ)設(shè)施所花費(fèi)的時(shí)間,,幫助數(shù)據(jù)中心輕松快速進(jìn)行 AI 部署,,為擴(kuò)展多 GPU 服務(wù)器節(jié)點(diǎn)提供更多支持。

本期的智能內(nèi)參,,我們推薦《NVIDIA DGX POD 數(shù)據(jù)中心參考設(shè)計(jì)》白皮書,,從傳統(tǒng)數(shù)據(jù)中心的 AI 轉(zhuǎn)型之困著手,結(jié)合 DGX POD 的應(yīng)用實(shí)例,,解讀 NVIDIA DGX POD 交付節(jié)點(diǎn)的核心亮點(diǎn),,為亟待快速轉(zhuǎn)型 AI 的數(shù)據(jù)中心架構(gòu)師,以及準(zhǔn)備構(gòu)建 AI 就緒型數(shù)據(jù)中心提供參考,。如需查閱此白皮書《NVIDIA DGX POD 數(shù)據(jù)中心參考設(shè)計(jì)》,,可直接點(diǎn)擊:NVIDIA DGX POD 數(shù)據(jù)中心參考設(shè)計(jì)白皮書 - 白皮書下載 - 英偉達(dá)AI計(jì)算專區(qū) - 智東西下載。

以下為智能內(nèi)參整理呈現(xiàn)的干貨:

數(shù)據(jù)中心 AI 轉(zhuǎn)型遭遇困局

大數(shù)據(jù)、AI 與云計(jì)算等新興技術(shù)卷起新的浪潮,,在各類數(shù)據(jù)中心中形成連鎖反應(yīng),。海量數(shù)據(jù)處理任務(wù)涌入數(shù)據(jù)中心,面對(duì)人工智能應(yīng)用的訓(xùn)練和推理,,令傳統(tǒng)的CPU 服務(wù)器難以招架,。

深度學(xué)習(xí)算法屬于計(jì)算密集型算法,與 NVIDIA GPU 計(jì)算架構(gòu)十分契合,。過去 CPU 需要花數(shù)十天完成的計(jì)算任務(wù),,通用 GPU 只用幾小時(shí)就能完成,,這大幅提升深度學(xué)習(xí)等并行處理數(shù)據(jù)方法的計(jì)算效率,使得以 GPU 為基礎(chǔ)的設(shè)備日漸成為各大數(shù)據(jù)中心進(jìn)行深度學(xué)習(xí)訓(xùn)練的首選,。

然而,,即便部署了強(qiáng)大的硬件設(shè)備,也不意味著數(shù)據(jù)中心的 AI 轉(zhuǎn)型計(jì)劃就萬事俱備了,,還有一個(gè)關(guān)鍵問題擺在眼前——架構(gòu)設(shè)計(jì),。

數(shù)據(jù)中心需要考慮的因素遠(yuǎn)不止算力,還需兼顧網(wǎng)絡(luò),、存儲(chǔ),、電源、散熱,、管理和軟件等方面問題,。

硬件組合不是簡單粗暴的積木堆疊,并不是說計(jì)算節(jié)點(diǎn)越多,,性能就會(huì)隨之線性增長,。其計(jì)算性能會(huì)受制于高速互聯(lián)網(wǎng)絡(luò),一旦出現(xiàn)數(shù)據(jù)擁堵,,整機(jī)系統(tǒng)的效率都可能被拖累,。另外,過多計(jì)算硬件堆疊,,可能導(dǎo)致功耗過大,,不利于日后的運(yùn)營。

因此,,數(shù)據(jù)中心必須思考如何打造了降本增效的最佳方式,,將各種硬件資源協(xié)同組合,在穩(wěn)定安全的狀態(tài)下,,以超低延遲和高帶寬訪問數(shù)據(jù)集,。

這對(duì)于缺乏 AI 部署經(jīng)驗(yàn)的傳統(tǒng)數(shù)據(jù)中心而言,無疑是個(gè)不小的挑戰(zhàn),。如果 DIY GPU 計(jì)算節(jié)點(diǎn),,不僅需要耗費(fèi)人力和時(shí)間成本,還要考慮計(jì)算,、存儲(chǔ),、交換機(jī)等各種硬件設(shè)備的集成兼容問題。

對(duì)于這一痛點(diǎn),,NVIDIA 提供了一個(gè)頗有吸引力的解決方案,。

它通過與領(lǐng)先的存儲(chǔ)、網(wǎng)絡(luò)交換技術(shù)提供商合作,,提供一系列 DGX POD 數(shù)據(jù)中心交付節(jié)點(diǎn)設(shè)計(jì)參考架構(gòu),,將 NVIDIA 長期積累的超大規(guī)模數(shù)據(jù)中心 AI 部署經(jīng)驗(yàn),轉(zhuǎn)化為可復(fù)制方案,,無論是大中小型數(shù)據(jù)中心,,均可以直接參考使用。

NVIDIA AI 超級(jí)計(jì)算機(jī)構(gòu)建經(jīng)驗(yàn)轉(zhuǎn)換

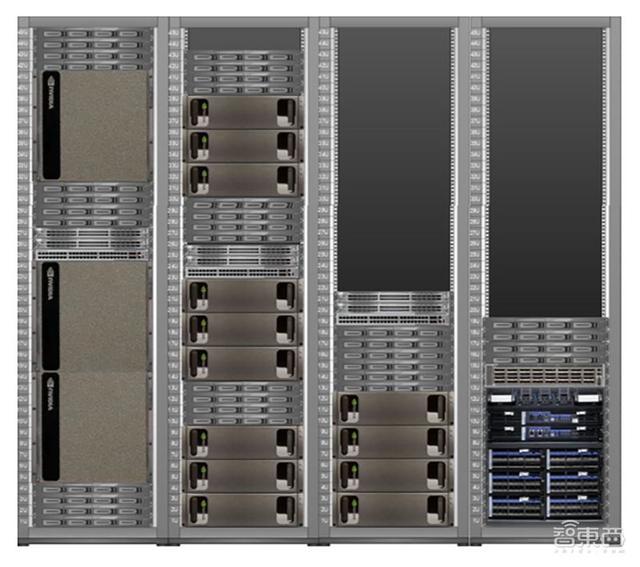

DGX POD 交付節(jié)點(diǎn)(Point of Delivery)是一種經(jīng)優(yōu)化的數(shù)據(jù)中心機(jī)架,包含多臺(tái) DGX-1 或 DGX-2 服務(wù)器,、存儲(chǔ)服務(wù)器和網(wǎng)絡(luò)交換機(jī)等最佳實(shí)踐,。

▲ DGX POD 參考架構(gòu)正面圖

這是 NVIDIA 構(gòu)建大量超大規(guī)模 GPU 加速計(jì)算節(jié)點(diǎn)的經(jīng)驗(yàn)之集大成者,。NVIDIA 曾建立了大型的 AI 數(shù)據(jù)中心,包含數(shù)千臺(tái)領(lǐng)先的 DGX 服務(wù)器加速計(jì)算節(jié)點(diǎn),。

今年6月,,NVIDIA 宣布推出全球速度排名第22位的超級(jí)計(jì)算機(jī) DGX SuperPOD,為企業(yè)快速部署自動(dòng)駕駛汽車項(xiàng)目,,提供同等大小的超算無法匹敵的 AI 性能,。

SATURNV 亦是 NVIDIA 基于 DGX 系統(tǒng)構(gòu)建的 AI 超級(jí)計(jì)算機(jī),支持自動(dòng)駕駛汽車,、機(jī)器人,、顯卡、HPC 等多領(lǐng)域的 NVIDIA 內(nèi)部 AI 研發(fā),。早在2016年推出之際,,DGX SATURNV 就登上 Green 500 超算榜第一,被評(píng)為全球最經(jīng)濟(jì)高效的超算,,整體運(yùn)算速度位列第28位,,是最快的 AI 超算。

基于使用 SATURNV 所遵循的設(shè)計(jì)原則和架構(gòu),,NVIDIA 在短短三周內(nèi)就打造出一套基于 NVIDIA DGX-2 配置的全新系統(tǒng) DGX SuperPOD,。近期 NVIDIA 借助一套基于 DGX-2 的配置在 MLPerf 基準(zhǔn)測(cè)試中創(chuàng)下六項(xiàng) AI 性能記錄。

在將 DGX SATURAN 打造成所有企業(yè)都可復(fù)制的,、經(jīng)驗(yàn)證的設(shè)計(jì)過程中,,NVIDIA 經(jīng)過實(shí)地檢驗(yàn)積累了豐富的經(jīng)驗(yàn),并將計(jì)算,、網(wǎng)絡(luò),、存儲(chǔ)等多方面的最佳實(shí)踐,集中于 NVIDIA DGX POD 的設(shè)計(jì)之中,。

如今,,包括 Arista,、思科、DDN,、Dell EMC,、IBM Storage、Mellanox,、NetApp 和 Pure Storage 等在內(nèi)的業(yè)內(nèi)數(shù)據(jù)中心領(lǐng)導(dǎo)者已圍繞 DGX POD,,推出了基于其各自特有技術(shù)的相關(guān)產(chǎn)品。

這些集成系統(tǒng)均為客戶提供經(jīng)過經(jīng)驗(yàn)驗(yàn)證的可靠方法,,這意味著,,每個(gè)企業(yè)都能量身定制完全適配自身需求的 AI 超算中心。

例如,,基于 DGX POD,,NetApp 推出了 NetApp ONTAP AI 融合基礎(chǔ)架構(gòu)。其由 NVIDIA DGX-1 服務(wù)器,、 NetApp 云互聯(lián)存儲(chǔ)系統(tǒng)提供支持,,是 NVIDIA 和 NetApp 聯(lián)合開發(fā)和驗(yàn)證的架構(gòu)。

借助這一架構(gòu),,企業(yè)可以從小規(guī)模起步進(jìn)行無縫擴(kuò)展,,智能管理跨邊緣、核心和云以及反向數(shù)據(jù)傳輸?shù)耐暾疃葘W(xué)習(xí)數(shù)據(jù)管道,,簡化 AI 部署,。

圍繞 NVIDIA DGX POD 參考架構(gòu)和 NetApp ONTAP AI,英國劍橋咨詢公司構(gòu)建了一套專門的 AI 研究設(shè)施,,用于訓(xùn)練一個(gè)能即刻準(zhǔn)確識(shí)別各種音樂流派的 AI “狂熱愛好者”,。

借助參考框架,其 AI 項(xiàng)目所帶來的對(duì)計(jì)算,、存儲(chǔ),、網(wǎng)絡(luò)設(shè)施的需求均得到滿足。經(jīng)過在16臺(tái) NVIDIA GPU 上接受數(shù)百小時(shí)的音樂訓(xùn)練,,這位特殊的音樂愛好者,,在“聽音識(shí)流派”的準(zhǔn)確度上,甚至超越了人類和傳統(tǒng)編程,。

AI 軟件:調(diào)優(yōu) DGX 硬件,,降低管理門檻

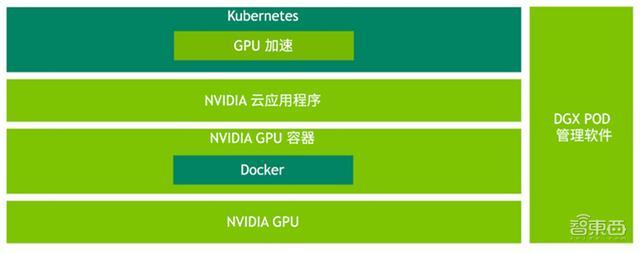

除了設(shè)計(jì)優(yōu)化的 DGX 服務(wù)器,、存儲(chǔ)服務(wù)器和網(wǎng)絡(luò)交換機(jī)組合 ,DGX POD 上還運(yùn)行一整套適配的 NVIDIA AI 軟件堆棧,極大簡化 DGX POD 的日常操作與維護(hù),,為大規(guī)模多用戶 AI 軟件開發(fā)團(tuán)隊(duì)提供高性能的深度學(xué)習(xí)訓(xùn)練環(huán)境,。

▲ NVIDIA AI 軟件堆棧

NVIDIA AI 軟件包括 DGX 操作系統(tǒng)(DGX OS),、集群管理和協(xié)調(diào)工具,、工作負(fù)載調(diào)度器,、來自 NVIDIA GPU Cloud (NGC) 容器注冊(cè)表的和優(yōu)化容器,可以為使用者提供優(yōu)化的操作體驗(yàn),。

DGX POD 管理軟件可根據(jù)需要,,自動(dòng)創(chuàng)新安裝 DGX OS。DGX OS 是 NVIDIA AI 軟件堆棧的基礎(chǔ),,基于優(yōu)化版 Ubuntu Linux 操作系統(tǒng)構(gòu)建,,并專門針對(duì) DGX 硬件進(jìn)行調(diào)優(yōu),支持各種 NVIDIA 庫和框架及 GPU 的容器進(jìn)行時(shí),。

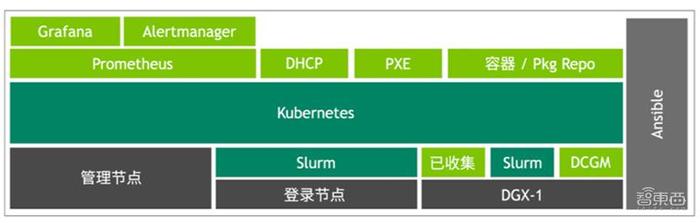

▲ DGX POD 管理軟件層

DGX POD 管理軟件層由 Kubernete 容器協(xié)調(diào)框架上運(yùn)行的各項(xiàng)服務(wù)組成,,可通過網(wǎng)絡(luò)(PXE)為動(dòng)態(tài)主機(jī)配置協(xié)議(DHCP)和全自動(dòng) DGX OS 軟件配置提供服務(wù),。

通過使用其簡單的用戶界面,管理員可在由 Kubernetes 和 Slurm 管理的域中移動(dòng) DGX 服務(wù)器,。未來 Kubernetes 增強(qiáng)功能預(yù)計(jì)在純 Kubernetes 環(huán)境中,,支持所有 DGX POD 用例。

DGX POD 上的 NVIDIA AI 軟件可借助 Ansible 配置管理工具進(jìn)行管理,,白皮書中有提供其開源的軟件管理堆棧和文檔在 Github 上的鏈接,。

智東西認(rèn)為,DGX POD 一站式交付節(jié)點(diǎn)解決方案,,不僅能加速數(shù)據(jù)中心的 AI 部署效率,,同時(shí)也通過提供更強(qiáng)大的算力,大幅度提升數(shù)據(jù)的利用效率,。

當(dāng)前,,很多數(shù)據(jù)中心剛剛踏入或計(jì)劃踏入 AI 的大門,而當(dāng)下主流的深度學(xué)習(xí)算法必須配備專業(yè)的 AI 基礎(chǔ)設(shè)施,?;?NVIDIA DGX POD 的架構(gòu)方案,對(duì)于快速構(gòu)建大規(guī)模 AI 計(jì)算集群非常具有參考價(jià)值,。隨著此類基礎(chǔ)架構(gòu)逐漸普及,,更多數(shù)據(jù)中心將得以消除設(shè)備與資本預(yù)算之間的鴻溝。

這只是 NVIDIA 打造 AI 就緒型數(shù)據(jù)中心宏圖的重要版面之一,,利用 DGX-1,、DGX-2 服務(wù)器和NVIDIA GPU 大規(guī)模計(jì)算架構(gòu)的發(fā)展進(jìn)步,,NVIDIA 正將機(jī)器學(xué)習(xí)、深度學(xué)習(xí)和高性能計(jì)算(HPC)擴(kuò)展到更多的數(shù)據(jù)中心,,為金融,、能源、制造,、電信,、醫(yī)療、科學(xué)計(jì)算等更多行業(yè)的生產(chǎn)力提升提供動(dòng)力引擎,。

轉(zhuǎn)載請(qǐng)注明來自浙江中液機(jī)械設(shè)備有限公司 ,,本文標(biāo)題:《NVIDIA集成AI超算中心經(jīng)驗(yàn),,打造AI就緒型數(shù)據(jù)中心》

浙ICP備18034934號(hào)-2

浙ICP備18034934號(hào)-2 浙ICP備18034934號(hào)-2

浙ICP備18034934號(hào)-2

還沒有評(píng)論,,來說兩句吧...